文章详情页

group-by - mysql group by 优化的问题

浏览:199日期:2022-06-14 17:40:23

问题描述

我有一张接近八千万条数据的彩虹表,然后里面有二十多万条的重复数据,我想使用GROUP BY 进行分组,但是使用了GROUP BY语句以后,mysql会生出一张零时表,而零时表,把我的硬盘全部沾满了,所以,求个办法,能帮去去处这重复的数据?

我的sql:

sql:

SELECT COUNT(id) FROM password WHERE length = 4 GROUP BY ciphertext

问题解答

回答1:不赞成用一条SQL语句来搞定这类问题,因为数据库耗不起。可以用程序来实现(比如写个Python脚本),步骤是这样的:

把表A(8千万行)复制一个表结构,产生一张空表B;

对B的ciphertext列做唯一索引;

遍历表A的每一行,插入到表B,可以用REPLACE或INSERT INTO ... ON DUPLICATE KEY UPDATE ...

校验表B的数据,如果结果正确,则删除表A,把表B重命名为表A。

相关文章:

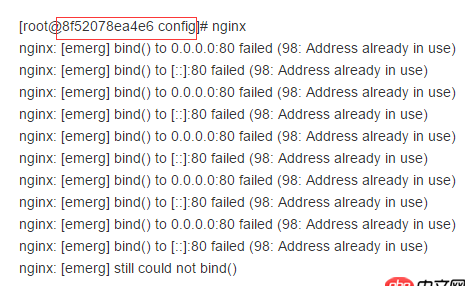

1. javascript - 移动端 点击弹出遮罩层 加断点调试就行 不加断点就不行2. nignx - docker内nginx 80端口被占用3. docker-machine添加一个已有的docker主机问题4. docker容器呢SSH为什么连不通呢?5. angular.js使用$resource服务把数据存入mongodb的问题。6. docker images显示的镜像过多,狗眼被亮瞎了,怎么办?7. dockerfile - 为什么docker容器启动不了?8. docker安装后出现Cannot connect to the Docker daemon.9. 关于docker下的nginx压力测试10. javascript - 正则匹配字符串特定语句后的数字

排行榜

网公网安备

网公网安备