文章详情页

python - Scrapy如何得到原始的start_url

浏览:237日期:2022-06-27 15:45:21

问题描述

Scrapy爬虫时,由于重定向或是其他原因,会导致原始的start_url发生改变,怎样才能得到原始的start_url?

def start_requests(self): start_url = ’your_scrapy_start_url’ yield Request(start_url, self.parse) def parse(self, response): item = YourItem() item[’start_url’] = 原始请求的start_url yield item

问题解答

回答1:参考文章:Scrapy爬虫常见问题总结

利用Request中的meta参数传递信息

def start_requests(self): start_url = ’your_scrapy_start_url’ yield Request(start_url, self.parse, meta={’start_url’:start_url}) def parse(self, response): item = YourItem() item[’start_url’] = response.meta[’start_url’] yield item

相关文章:

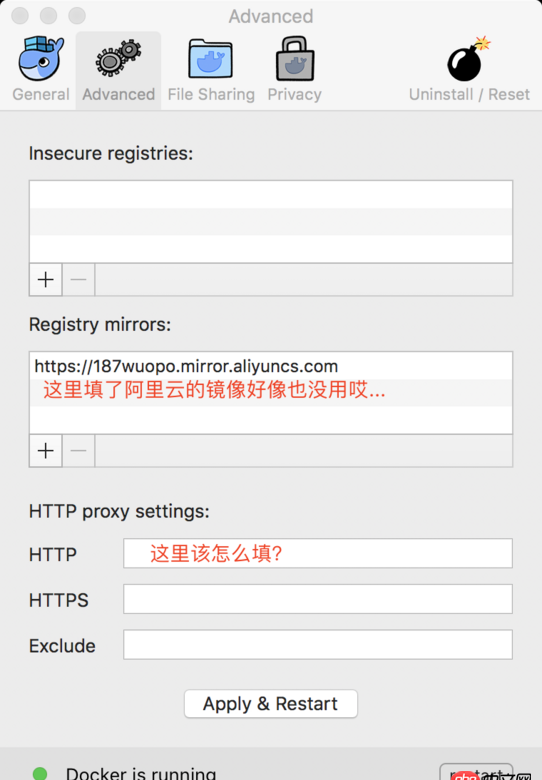

1. docker内创建jenkins访问另一个容器下的服务器问题2. nignx - docker内nginx 80端口被占用3. golang - 用IDE看docker源码时的小问题4. macos - mac下docker如何设置代理5. docker镜像push报错6. debian - docker依赖的aufs-tools源码哪里可以找到啊?7. 关于docker下的nginx压力测试8. docker安装后出现Cannot connect to the Docker daemon.9. docker start -a dockername 老是卡住,什么情况?10. dockerfile - 为什么docker容器启动不了?

排行榜

网公网安备

网公网安备