文章详情页

python redis 列表插入 速度太慢

浏览:242日期:2022-06-27 17:15:54

问题描述

pool = redis.ConnectionPool(host=host, port=port)client = redis.StrictRedis(connection_pool=pool)for i in range(10000): for j in range(30):client.lpush(IDLE_TASKS, json.dumps(args))

这种执行效率低的可怕。需要等几十秒,才能插入完成。请问有没更高效率的处理手法?

args 只是以一个元组内容随意(1,2,'3')之类

问题解答

回答1:因为我个人没用过redis这个库, 所以只能尝试从你给出的代码去给些建议, 不喜勿喷:

1.不知道你的这个args是哪来的, 但是在这个循环体中, 似乎没看到改变, 所以能否将这个json.dumps(args)放到循环体外面执行:

args_dump = json.dumps(args)for i in range(10000): for j in range(30):client.lpush(IDLE_TASKS, args_dump)

2.看到你大概要生成30万的同样的数据, 能否将这个数据先生成, 再一次性client.lpush? 因为毕竟tcp也有自身的延迟因素

3.可以通过cProfile库去找出耗时长的地方, 也可以尝试换别的库去实现(这个具体得自己去google了)

相关文章:

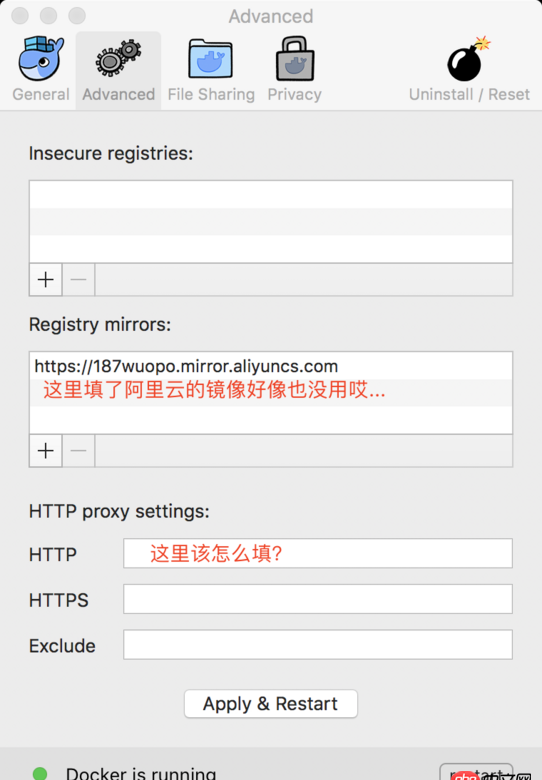

1. docker start -a dockername 老是卡住,什么情况?2. docker内创建jenkins访问另一个容器下的服务器问题3. debian - docker依赖的aufs-tools源码哪里可以找到啊?4. docker images显示的镜像过多,狗眼被亮瞎了,怎么办?5. docker镜像push报错6. docker-machine添加一个已有的docker主机问题7. dockerfile - 为什么docker容器启动不了?8. macos - mac下docker如何设置代理9. 关于docker下的nginx压力测试10. nignx - docker内nginx 80端口被占用

排行榜

网公网安备

网公网安备