文章详情页

python 多进程 或者 多线程下如何高效的同步数据?

浏览:308日期:2022-06-29 13:11:23

问题描述

在多线程 /多进程时,通过queue之类轻松获取任务。但是当任务完成后,为了统计当前任务的完成数量.需要对一个值进行累加.目前多线程/多进程情况下。我用到的是线程的lock/ 进程的manager + 进程的lock,来处理记数的同步问题。但是感觉效率太低了。不够优雅。

请问有什么更好的方式来处理?

感觉这种问题应该经常会用到。应该早就存在各种完美的解决方法。只是我还没注意到。

问题解答

回答1:进程间通信的问题,可以用你喜欢的(熟悉的、可以用的)方式来解决。下面提供一种方式:

zmq 的 pushpull 模式http://learning-0mq-with-pyzm...

相关文章:

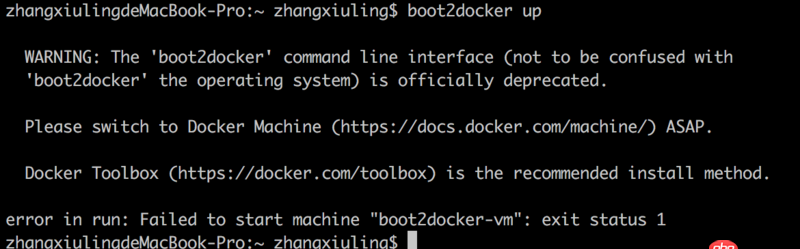

1. dockerfile - 我用docker build的时候出现下边问题 麻烦帮我看一下2. docker api 开发的端口怎么获取?3. boot2docker无法启动4. docker不显示端口映射呢?5. docker-compose中volumes的问题6. debian - docker依赖的aufs-tools源码哪里可以找到啊?7. mysql - phpmyadmin怎么分段导出数据啊?8. docker images显示的镜像过多,狗眼被亮瞎了,怎么办?9. macos - mac下docker如何设置代理10. docker start -a dockername 老是卡住,什么情况?

排行榜

网公网安备

网公网安备