文章详情页

python - scrapy 再次请求的问题

浏览:198日期:2022-08-17 18:54:48

问题描述

如:item[’url’]=response.xpath(’a/@href’)分析出一个链接,然后想从这个链接里的网页再获取一些元素,放入item[’other’]。应该怎么写,谢谢。

问题解答

回答1:def parse_page1(self, response): for url in urls:item = MyItem()item[’url’] = urlrequest = scrapy.Request(url,callback=self.parse_page2)# request = scrapy.Request('http://www.example.com/some_page.html',dont_filter=True,callback=self.parse_page2)request.meta[’item’] = itemyield requestdef parse_page2(self, response): item = response.meta[’item’] item[’other’] = response.xpath(’/other’) yield item

最后附上官方文档https://doc.scrapy.org/en/lat...中文翻译版http://scrapy-chs.readthedocs...

相关文章:

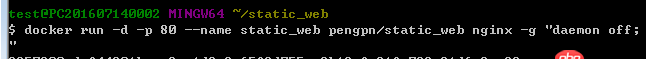

1. docker绑定了nginx端口 外部访问不到2. python - 使用pandas的resample报错3. android - 类似于微信朋友圈图片这样的是在listview中嵌套gridview还是动态加入多个imageview呢?4. docker-machine添加一个已有的docker主机问题5. java - xml 传输数据如何处理更好6. html - 类似这样的弹层用什么插件写比较好?7. vue.js - vue-router开启HTML5的history模式后nginx配置8. python - flask post提交timestamp不能作为参数,这是为什么?9. 这个java项目有一个首页地址是微信前台的,这个所谓的微信前台指的是什么?10. IOS app应用软件的id号怎么查询?比如百度贴吧的app-id=477927813

排行榜

网公网安备

网公网安备