文章详情页

python - mongodb去重

浏览:250日期:2022-10-14 09:36:55

问题描述

1.功能里需要根据有一个字段来判断是否重复,比如叫做ownnerId,凡是存在的就丢弃.于是我用到了distinct这个方法,但是这段时间随着数据量逐渐增大,出现了一个问题:

OperationFailure: distinct too big, 16mb cap

这是命令行里边的错误,说distinct返回的结果太大了,超过了16M.请问各位高手能否贡献一些方法.

需求:每次通过检查数据库中ownnerId这个字段是否出现了,其中数据库是一直在更新的,而且这个不存在的ownnerId在一会处理后就会存到数据库中去,所以要求每次判断都要重新检查一遍数据库中这个ownner字段.因此对速度的要求也比较高.各位大神瞅瞅,求给个意见.

问题解答

回答1:如果我理解的对的话,是否考虑过Unique Indexes。

供参考。

Love MongoDB! Have fun!

相关文章:

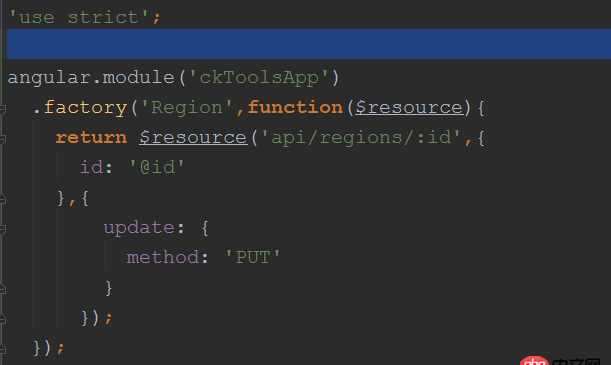

1. vim - docker中新的ubuntu12.04镜像,运行vi提示,找不到命名.2. docker - 各位电脑上有多少个容器啊?容器一多,自己都搞混了,咋办呢?3. docker不显示端口映射呢?4. angular.js使用$resource服务把数据存入mongodb的问题。5. docker容器呢SSH为什么连不通呢?6. docker绑定了nginx端口 外部访问不到7. 为什么redis中incr一个“0” 会报错?8. dockerfile - [docker build image失败- npm install]9. docker start -a dockername 老是卡住,什么情况?10. android - 优酷的安卓及苹果app还在使用flash技术吗?

排行榜

网公网安备

网公网安备